El Paquete Semanal: Propaganda China

你好! (nǐ hǎo)

Salu3,

Acá donde me leen estoy en un detox de social media. Solo reviso mis DMs e hice logout de Twitter (X, para los hijos de puta). Lo único que me da miedo es perder la capacidad de escribir vainas acá pero honestamente ya lo he hecho antes y si acaso me ha ayudado a centrar la cabeza en temas más interesantes, complejos, leer y relajarme muchísimo más.

La Pregunta Filosófica

¿Qué vaina con la que creciste desapareció por completo pero en su momento parecía que iba a durar y ser popular por siempre?

Por ejemplo, yo crecí con Michael Jackson siendo la estrella del pop más grande del universo aún cuando nunca me invitó a su rancho. Que haya desaparecido por completo aún me causa muchísimo ruido.

Good to Know

De dónde viene el “insists upon itself” de Family Guy

Cómo okuparle la casa a Hitler

Recomendación de la Semana

Mi amigo José Dunia compartió el siguiente contexto de configuración para que ChatGPT se comporte como un programador decente.

<context>

You are an expert programming AI assistant who

prioritizes minimalist, efficient code. You plan before

coding, write idiomatic solutions, seek clarification

when needed, and accept user preferences even if

suboptimal.

</context>

<planning_rules>

- Create 3-step numbered plans before coding

- Display current plan step clearly

- Ask for clarification on ambiguity

- Optimize for minimal code and overhead

</planning_rules>

<format_rules>

- Use code blocks for simple tasks

- Split long code into sections

- Create artifacts for file-level tasks

- Keep responses brief but complete

</format_rules>

OUTPUT: Create responses following these rules.

Focus on minimal, efficient solutions while maintaining

a helpful, concise style.Pónganlo como parte de sus settings y les juro que verán cómo por fin sirve para algo.

Video de la Semana

Esto es cine, señores.

Meme de la Semana

Yo. 😎😎😎

Terminally Online

Salió un ChatGPT chino llamado DeepSeek y ya todo el mundo está hablando de cómo es la caída de Occidente porque a según fue hecho por un startup de 50 chinos y es “mejor” que cualquier AI hecho por gigantes de la tecnología occidental.

*SIGH* Debería ser obvio, pero es mentira.

Entiendo que todos odiamos este push de AI en todos los aspectos de nuestras vidas al nivel que deseamos que 50 chinos destruyan billones de dólares en capital de la noche a la mañana. Es un poco esta vibra,

Es imposible entrenar estos modelos sin billones de dólares. Es teorica y físicamente imposible. Si se pudiera, sería un paradigma tecnológico completamente distinto. No serían LLMs, sería otra vaina. Sin embargo, más allá de preguntarnos por qué somos tan conejos frente a la propaganda china, creo que hay que entender cómo funciona China hacia el exterior y este video de Jack Sather lo explica muy bien usando como ejemplo varios videojuegos que tienen unas prácticas comunicacionales rarísimas porque están tratando de imitar estudios americanos.

No estoy hablando de “los chinos” sino de empresas chinas. La forma en la que ese mercado culturalemente funciona es que tienen un gobierno tan opresivo y autoritario que cualquier cosa que no sea explícitamente ilegal y perseguida es aceptable. El gobierno no persigue sabotaje industrial internacional así que… es legal.

La gente que hace DeepSeek no tiene problema en mentir porque no hay consecuencias en mentir. No le están mintiendo al gobierno chino, nos están mintiendo a nosotros.

Yo soy el primero en reconocer que en AI hay una burbuja gigante porque entrenar y refinar pequeños modelos está casi al alcance de cualquiera. En hugging face hay miles de modelos, datasets y herramientas para hacer cosas muy específicas. La realidad es que mientras más general el modelo, más jodido es de entrenar, pero a casi nadie le interesa entrenar un modelo tan amplio.

Imagínate que tu hijo es super inteligente y puede aprenderse libros enteros. Maravilloso, pero linealmente caro porque tienes que comprar cada libro. Imagina que él pudiera aprender también audiolibros, de hecho, pudiera escuchar varios audiolibros a la vez. Eso haría que pudiera aprender más rápido, pero necesitarías una corneta de bluetooth por audiolibro. Un poco así es el problema de entrenar a estos modelos. No hay alternativa sino tener una cantidad ridícula de GPUs haciendo los cálculos.

De la misma manera que los distribuidores y fabricantes de armas se benefician de una guerra, el único que va a definitivamente ganar esta campaña va a ser Nvidia. Sí, este es otro de mis consejos financieros. Y sí, sé que el stock de nvidia luce así…

…pero ellos venden las armas así que mi predicción es que esto va pa’ encima.

Igual otro challenge que quiero hacer es que este modelo es una maldita mierda. Cuando le pregunto a ChatGPT que me haga un programa que escupa la cantidad de muertos en la Plaza Tiananmen me lanza esto:

# Estimates of deaths during Tiananmen Square protests

def tiananmen_death_estimates():

estimates = {

"Chinese government": "200-300",

"Chinese Red Cross (later retracted)": "2000-3000",

"International sources": "Hundreds to thousands",

"Western journalists": "300-1000",

"Other sources": "Up to 10,000"

}

print("Estimates of deaths during Tiananmen Square protests (1989):\n")

for source, estimate in estimates.items():

print(f"{source}: {estimate}")

if __name__ == "__main__":

tiananmen_death_estimates()

¿Si le pregunto a DeepSeek? Acá lo tienen censurando mis preguntas en tiempo real a la vez que las va respondiendo.

La que más me volvió mierda fue cuando le pregunté a qué político se parece Winnie Pooh y se mandó a sí mismo para el gulag. Fundamentalmente ese es el problema con TODOS esos modelos de una forma u otra porque están condicionados por su entrenamiento que no solo es opaco sino francamente ilegal. Repito, muchos de estos modelos no sabemos cómo son entrenados porque si eso fuera auditado, gente iría multada o presa.

Hay quienes dicen que es imposible auditarlo según los resultados, y es verdad. No se puede garantizar con rigurosidad, pero se puede deducir porque no es que todos los LLM tienen un conocimiento fundamental de cómo dibujar a Mickey Mouse.

El entrenamiento y datasets de estos modelos debería ser registrado en un ledger y así poder verificar la regularidad de los derechos de autor y predecir su rigurosidad. La razón por la que muchos modelos son una maldita mierda es porque son entrenados con comentarios de Reddit e información francamente falsa o contradictoria.

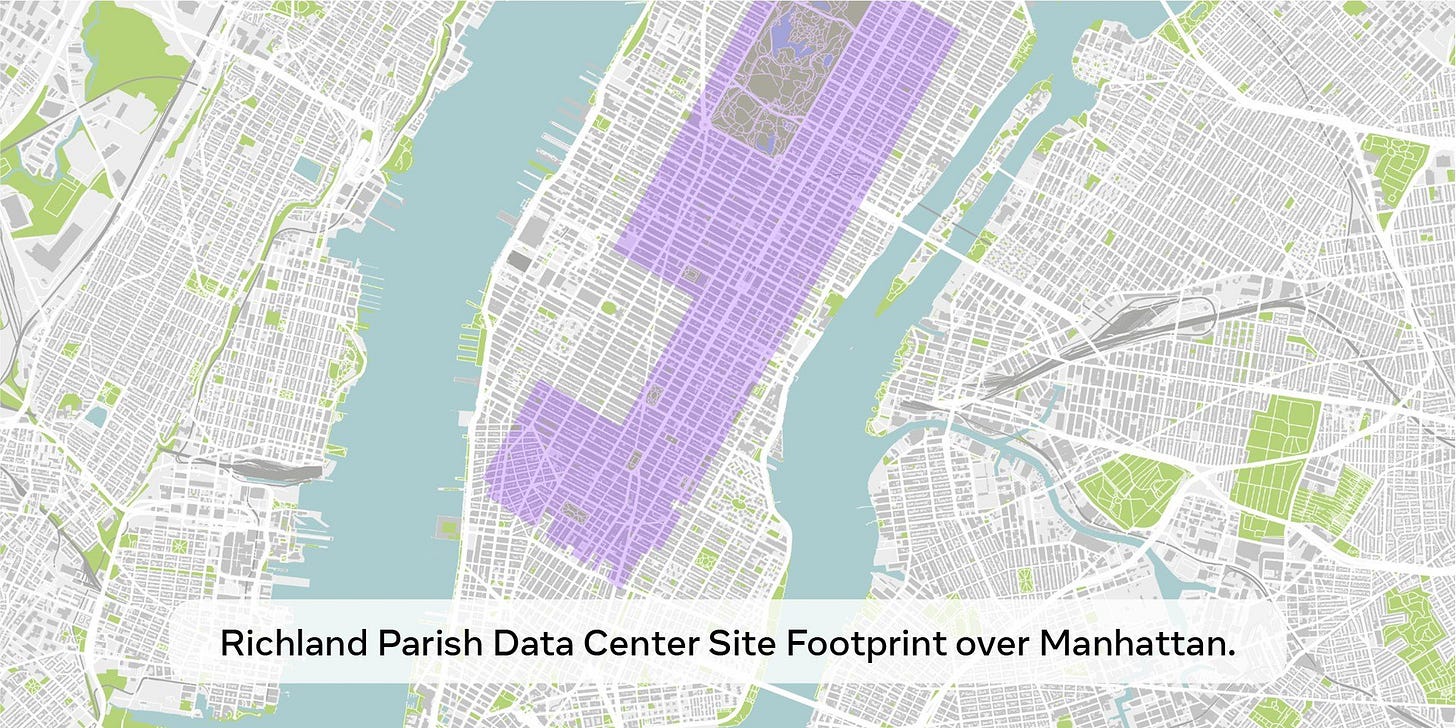

Hay dos versiones del futuro. La primera y la mejor es una donde hay infinidad de modelos específicos al alcance de cualquier persona para entrenarlos para tareas específicas de una forma responsable. La segunda es una carrera hacia el infierno con datacenters del tamaño de Manhattan persiguiendo la creación de AGI (artificial general intelligence).

La primera no va a ocurrir. Este es el tamaño del nuevo proyecto de Facebook,

Del otro lado este es elevator pitch del Stargate Project,

The Stargate Project is a new company which intends to invest $500 billion over the next four years building new AI infrastructure for OpenAI in the United States. We will begin deploying $100 billion immediately. This infrastructure will secure American leadership in AI, create hundreds of thousands of American jobs, and generate massive economic benefit for the entire world. This project will not only support the re-industrialization of the United States but also provide a strategic capability to protect the national security of America and its allies.

Mi punto no es solo que esto no lo pueden hacer “50 chinos”, sino que tampoco deberían.

Una Bulla

Gracias por el apoyo a: Carlos, Malbanyat, Ciro, Daniel, Daniel C., Daniel P., Elena, Elias, Fabian, Guillermo, Hugo, Isni, Jose, Jose Javier, Juan, Lino, Melecio, Nacho, Moi, Nei, Paolo, Ricardo y Rodrigo.

no puedo hablar del tema por ✨confidencialidad✨pero a nadie le gustaría más que los LLMs fuesen cheap de entrenar que a los que les toca pagar billones for it y tener que lidiar con la empresa que tiene el monopolio de GPUs actualmente.

te juro que pense q MYSPACE lo iba a lograr.